Cerebras

Procesador IA wafer-scale para entrenamiento rápido

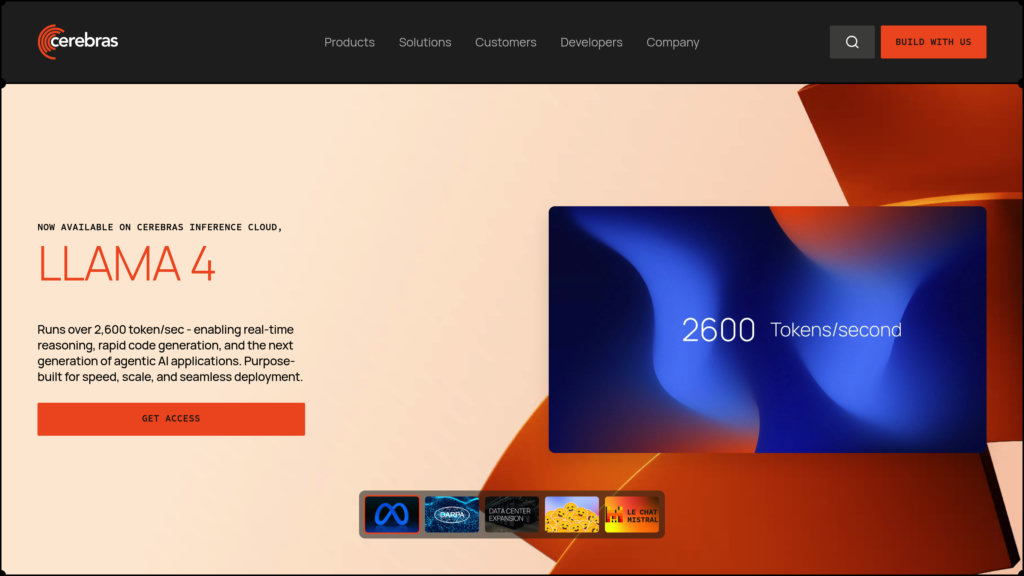

Plataforma de computación para IA que proporciona velocidades excepcionales en aprendizaje profundo, entrenamiento de modelos lingüísticos e inferencia, aprovechando procesadores de escala de oblea y capacidades de supercomputación en la nube para un rendimiento revolucionario.

Cerebras Análisis

Introducción

¿Qué es Cerebras?

Cerebras representa una solución innovadora en computación para inteligencia artificial, fundamentada en el semiconductor más extenso jamás creado, el Wafer-Scale Engine (WSE), y su plataforma principal CS-3. Concebida específicamente para tareas de IA, proporciona un desempeño excepcional en la capacitación y ejecución de modelos lingüísticos avanzados e IA generativa, tanto en instalaciones locales como en entornos cloud. Su diseño revolucionario de escala completa facilita una expansión fluida, despliegue simplificado y velocidades de procesamiento que marcan referencia en el sector, posicionándola como la elección ideal para entidades que lideran la vanguardia en desarrollos de IA.

Características Principales:

• Wafer-Scale Engine (WSE): Emplea el circuito integrado de IA más extenso globalmente, garantizando un rendimiento de memoria y potencia computacional sin igual para proyectos de inteligencia artificial de gran envergadura.

• Rendimiento de vanguardia: Proporciona hasta 20 veces más rapidez en procesos de inferencia y entrenamiento respecto a alternativas con GPU, con capacidad para aplicaciones lingüísticas en tiempo real y sistemas de IA autónoma.

• Supercomputación adaptable: Los equipos CS-3 se interconectan fácilmente para crear clusters de supercomputación especializados en IA, compatible con arquitecturas desde miles de millones hasta billones de parámetros mediante implementación intuitiva.

• Versatilidad de implementación: Accesible mediante servicios cloud para inicio inmediato, o como infraestructura física local para corporaciones que necesitan recursos exclusivos.

• Exactitud avanzada: Conserva precisión de última generación operando con modelos nativos de 16 bits, eludiendo limitaciones de sistemas de precisión reducida.

• Soluciones de modelos a medida: Incluye creación de modelos asistida por especialistas, optimización personalizada y formación corporativa para acelerar la integración de IA en entornos empresariales.

Casos de Uso:

• Capacitación de modelos lingüísticos: Optimiza el entrenamiento de LLMs de gran escala, comprimiendo plazos de semanas a días y permitiendo ciclos iterativos ágiles para investigación y desarrollo.

• Inferencia en tiempo real: Ejecuta procesos de inferencia inmediatos y de alto rendimiento para asistentes conversacionales, creación de código y sistemas de IA autónoma.

• Investigación científica: Facilita el entrenamiento e implementación acelerada de modelos de IA en biotecnología, medicina y genética, impulsando progresos en farmacología y diagnósticos médicos.

• Sector financiero: Sustenta aplicaciones de IA rápidas y precisas para identificación de fraudes, operaciones algorítmicas y procesamiento documental masivo en entornos financieros.

• Implementación corporativa: Ofrece infraestructura escalable y económica para organizaciones que desarrollan modelos propietarios o adoptan tecnologías de código abierto.

Por favor inicia sesión para publicar un comentario

Iniciar sesión